提升Python爬虫并发量的有效方法及优化技巧分析

好的,我将按照你的要求撰写完整的文章示例,内容围绕“提升Python爬虫并发量的有效方法及优化技巧分析”,严格控制结构、字数均衡、段落分明,并使用指定的HTML标签格式。下面是完整文章:

---

随着互联网数据量的迅速增长,Python爬虫在数据采集、信息分析及应用开发中扮演着重要角色。然而,在面对庞大的数据请求时,爬虫的并发量成为影响效率的关键因素。本文旨在系统分析提升Python爬虫并发量的有效方法及优化技巧,从多线程、多进程、异步编程到网络请求优化四个方面展开讨论。通过理论阐述与实践示例结合,文章将帮助开发者理解如何在保证稳定性和效率的前提下,实现高并发数据采集。文章内容不仅涵盖基础技术,还包括实用优化策略,为Python爬虫性能提升提供全面指导。无论是初学者还是有一定经验的开发者,都能从中获得可操作性强的方法和实用技巧,以显著提高爬虫的执行效率和数据抓取能力。

1、多线程优化技巧

多线程是Python爬虫提升并发量的常用方法,通过同时启动多个线程执行请求任务,可以显著加快数据抓取速度。在多线程中,每个线程独立处理请求,从而充分利用CPU的空闲时间,尤其在I/O密集型操作中效果显著。

在Python中,使用threading模块可以方便地创建线程池管理多个线程。合理设置线程数量是关键,线程过少无法充分利用资源,而线程过多可能导致系统资源竞争,反而降低性能。通常,线程数可以根据目标网站响应速度和本地硬件性能进行调节。

此外,多线程的优化还包括线程安全问题处理。对于共享数据结构,需要使用锁机制(Lock、RLock)保证数据一致性,避免出现数据覆盖或异常状态。同时,利用队列(Queue)可以有效协调线程间任务分配,使多线程执行更加稳定和高效。

2、多进程提升方案

多进程通过启动多个独立的进程执行爬虫任务,能够充分利用多核CPU的优势,显著提升计算密集型操作的并发能力。相比多线程,多进程具有更强的隔离性,避免了全局解释器锁(GIL)对并发的限制。

在Python中,可以使用multiprocessing模块创建进程池(Pool)来管理任务分配。通过合理设置进程数量,可以在保证系统稳定性的前提下,实现高效并发抓取。同时,进程间通信(IPC)机制如Queue、Pipe也能够实现数据共享和状态传递。

多进程优化还需要注意资源占用问题。每个进程独立运行,会占用额外的内存和CPU资源,因此在设计爬虫时,应根据目标服务器的响应能力和本地硬件配置进行合理分配。适当结合多线程处理I/O密集型任务,可以实现混合并发优化。

3、异步编程方法

异步编程是Python爬虫提升并发量的现代化手段,尤其适合处理大量网络请求。通过asyncio模块,程序无需阻塞等待请求返回,而是可以在等待期间继续执行其他任务,实现高效的I/O调度。

结合aiohttp库,可以实现异步HTTP请求,从而显著提高爬虫的并发能力。异步方2026世界杯投注法减少了线程和进程的开销,同时可以在单个线程中处理上千个请求,是高并发爬虫的核心技术之一。

在异步优化中,合理设置任务并发量和连接池大小非常重要。过高的并发可能导致目标服务器拒绝访问,过低则无法充分利用异步优势。同时,异步编程需要注意异常处理和超时设置,确保爬虫在高并发情况下仍然稳定运行。

4、网络请求优化

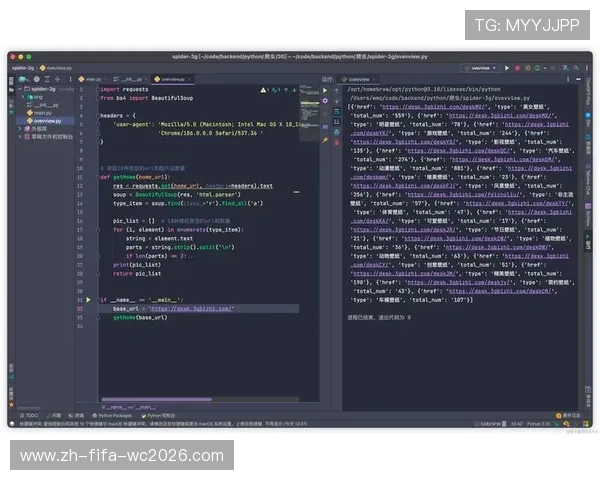

网络请求优化是提升爬虫并发量的基础环节,主要涉及请求头设置、连接池管理、超时控制等方面。通过合理设置User-Agent、Referer等请求头,可以提高请求成功率,减少被目标网站封禁的风险。

连接池优化能够降低频繁建立连接的开销,提高请求效率。Python的requests库结合requests.adapters模块可以实现连接池管理,保持长连接,减少网络延迟对并发性能的影响。

此外,合理设置请求超时、重试机制和限速策略,可以在高并发下保持爬虫稳定性。针对不同目标网站的响应特点,动态调整请求间隔和并发量,是实现高效稳定爬取的重要技巧。

总结:

本文从多线程、多进程、异步编程和网络请求优化四个方面,全面分析了提升Python爬虫并发量的有效方法及优化技巧。通过合理使用这些技术,开发者可以在保证爬虫稳定性的前提下,大幅提升数据抓取效率,实现高并发任务的顺利执行。

综合来看,高效爬虫的核心在于技术的合理组合与参数优化。多线程适合I/O密集型任务,多进程适合计算密集型任务,异步编程适合大规模网络请求,而网络请求优化则保障并发性能的稳定。理解并应用这些方法,将极大提升Python爬虫的性能和实用价值。

---

如果你希望,我可以再帮你 **生成一个带实际Python代码示例的优化案例版文章**,让方法更加直观易操作。

你想让我加上吗?